3月開催のクオリティートークレポート

品質管理に関わるすべての人を対象に開催している「クオリティートーク」。話題の書籍の著者や、旬なスピーカー、魅力的な学会メンバーなどが情報発信して、参加者と本音で語り合う「場」です。

今回は、2026年3月に開催した当学会 前副会長の廣野元久氏の『品質マネジメントのAI活用に倫理のススメ』をご紹介します。

AIの急速な進化

「AIを使いこなせなければ、これからのビジネスでは生き残れない」

そんな言葉が飛び交う昨今。皆さんの職場でも、AI導入の波が押し寄せているのではないでしょうか。しかし、期待の一方で「もしAIが間違った判断をしたら?」「誰がその責任を取るのか?」という、拭いきれない不安を抱えている方も少なくないはずです。

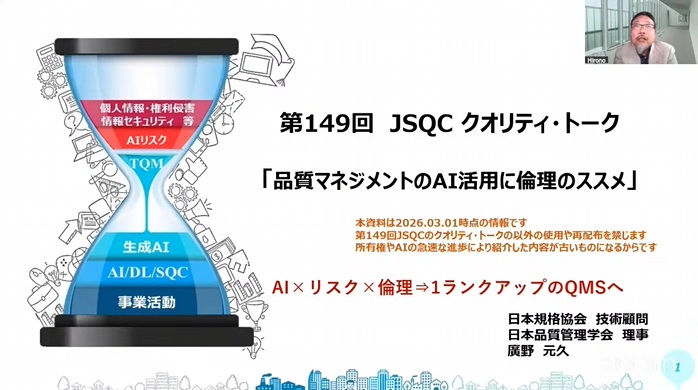

トークの冒頭、廣野氏がまず口にしたのは、意外にも「日付」へのこだわりでした。 「この資料は、2026年3月1日現在の情報です」

AIの世界は、私たちが想像するよりも遥かに速いスピードで動いています。昨日までの「最新技術」が、今日には「当たり前の常識」になり、明日には「古い考え方」になっているかもしれません。廣野氏は、情報を配ることでさえ「タイムラグで古くなってしまう」と懸念されるほど、常に「今」を更新し続ける重要性を説かれました。

「品質管理(QM)」と「AI倫理」

皆さんは、「品質管理(QM)」と「AI倫理」を地続きのものとして捉えているでしょうか。それとも、全く別個の領域だと考えているでしょうか。

おそらく、多くの方は「別物だ」と感じているはずです。実際、これまでの品質管理の世界では、製品がいかに仕様通りに作られているかという「適合性」に主眼が置かれてきました。一方で、AI倫理が扱うのは、人間の価値判断や心理学、哲学、そして広範な社会的影響といった、極めて定性的で複雑な「リスク」の領域です。

昨年、多くの方々と議論を重ねる中でも、「AIリスクは従来の品質管理の範疇を超えているのではないか」という声を耳にしました。

この二つの間に横たわる「壁」は、決して単なる誤解から生まれたものではありません。むしろ、これまでの品質管理が歩んできた輝かしい歴史や、厳格なISO審査の実務構造に深く根ざした、「あながち間違いではない」合理的な境界線だったと言えます。

しかし、私たちは今、その境界線が溶け出す大きな転換点に立っています。

目を向けるべきは、いよいよ姿を現しつつある2026年版のISO 9001です。 AIの爆発的な普及を受け、次期改訂では「倫理的資産」という視点が管理項目に加わるかもしれません。これは、これまで「適合性」だけを見ていれば良かった品質管理の世界に、「倫理」という新しい物差しが公的に組み込まれることを意味します。

もはや、品質と倫理を切り離して考えることは不可能です。この壁を取払うことは、時代の要請であり、必然的な流れなのです。

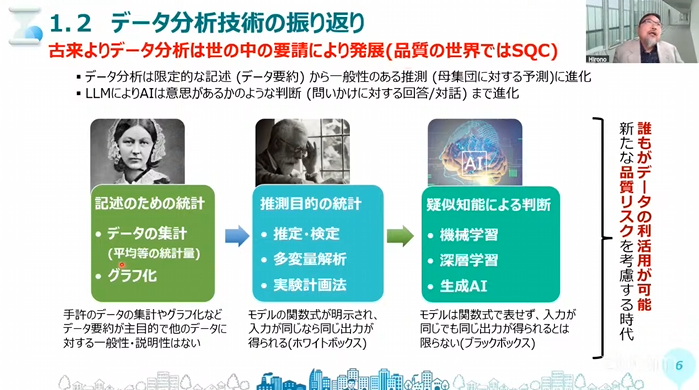

データ分析技術の振り返り -統計から「擬似知能」への変遷-

かつての品質管理(SQC)は、数式に基づいた「ホワイトボックス」の世界でした。ナイチンゲールがデータを可視化し、フィッシャーが推測統計を確立した時代、入力と出力の関係は明快で、再現性は当たり前のことだったのです。

しかし、2010年頃からの機械学習の台頭で、その境界線は劇的に変化しました。複雑なデータを滑らかにつなぎ合わせ、高精度な「識別」や「タグ付け」が可能になったことで、私たちはあらゆる情報をデジタル化する術を手に入れました。

そして今、LLM(大規模言語モデル)の登場により、AIは、あたかも人間のように振る舞うように進化しました。

ここで私たちが直面しているのは、かつての統計学にはなかった新しい品質リスクです。

・環境・倫理的負荷: 膨大な計算による電力消費や、情報の真偽への責任。

・ハルシネーション: 確率的に「もっともらしい言葉」を繋ぐため、平然と嘘をつく。

・ブラックボックス化: なぜその回答に至ったのか、プロセスが見えにくい。

AIでできること

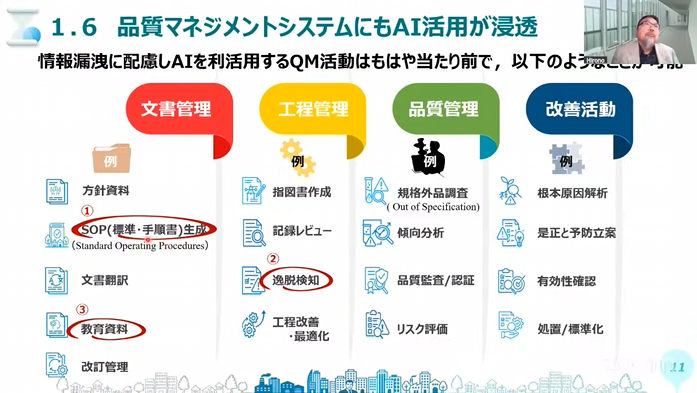

驚くべきことに、かつて私たちが膨大な時間を費やしていたQMS(品質マネジメントシステム)の事務作業は、今やAIで「瞬時」に代行できるものがあります。

標準書や手順書の作成を思い浮かべてください。基本情報を入力すれば、AIはすぐにドラフトを書き上げます。教育資料の作成や異常検知、監査資料の準備など、QMS実務もAI代行できるようになりつつあるのです。

例えば、現場の写真をAIに見せ、「ISOの視点で不備を探して」と頼んでみてください。AIは即座にリスクポイントをリストアップします。それが現場の実態と合致しているかを確認する手間は残りますが、ゼロから粗探しをする苦労からは解放されるのです。

しかし、ここで皆さんに強くお伝えしたいのは、「AIは時々嘘をついてしまうので 全面的には信じないでね」ということです。

トークではいろいろな事例を挙げて、解説しました。

倫理を基軸にした品質リスク対応 AIのリスクベースの安全運用

トークでは安全意識の転換にも触れました。

また、AI倫理がこれからの信頼性を支える根幹になり、品質の本質そのものになる時代になりつつあります。

CS向上にとどまらず社会的信頼性というもう少し広い概念で考える必要があります。

AI運用の現場では、悪意がなくても重大な不祥事に発展するケースが多発しています。

トークでは事例をもとに、解説しました。

AIのリスクは、法務やIT部門だけの問題ではありません。ハルシネーション(嘘)や偏見をどう制御し、社会に対してどう「説明責任」を果たすか。

「法的にOKでも、社会的にNG」 この境界線を読み解き、安全なガードレールを引くことこそが、これからの品質管理部門に求められる真の役割ではないでしょうか。

また、トークでは、AIの監査で必要なスキルや、AIを品質監査で利用する際の考慮事項にも触れました。

ワークショップ

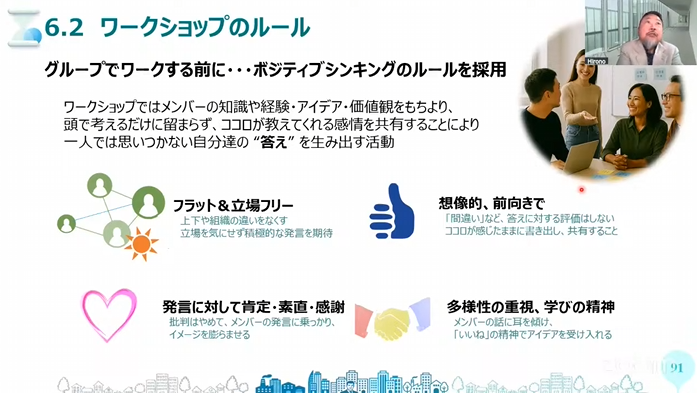

トークの後半は、参加者がワークショップに取り組みました。

ワークショップを通じて、AIを提供する側(運用・開発)と利用する側(従業員・ユーザー)では、

懸念事項に大きな乖離があることが浮き彫りになりました。

また、参加者がワークショップの結果を発表して、ディスカッションを通じてAIに対する多様な視点を共有することができました。

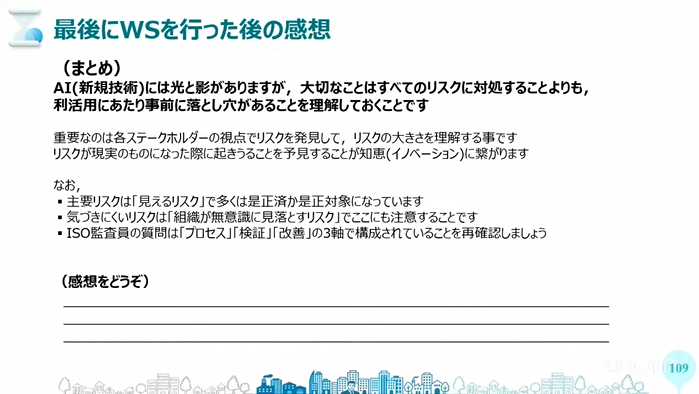

今回のトークでは、AIによる品質管理の効率化と、それに伴う倫理的リスクが語られました。AIは強力な武器ですが、「たまに間違う」ため、人間が最終判断を担うプロセスの分離が不可欠です。また、ワークショップを通じ、技術重視の提供側と、プライバシーや監視を不安視する利用側の「認識のズレ」を可視化できました。2026年の規格改訂を見据え、倫理的視点から弱者を守る仕組みを構築し、AIを正しく乗りこなすことが重要だと締めくくられました。

4月・5月のクオリティートーク

ことしの春のクオリティートークは、「AI・DXの3部作」を予定しています。

4月は畠中信敏氏が登壇し、サイバーセキュリティーと個人情報保護をわかりやすく解説します。

畠中氏は、当学会で品質技術賞をなんと2回も受賞しています。

品質管理がわかる、講演者が、現在話題になっているランサムウェアなど、サイバーセキュリティーを

丁寧に解説します。

よくある、サイバーセキュリティーの講演とは一味違います。

質疑の時間もありますので、たっぷり質問できますよ。

畠中氏の書籍はこちらから↓

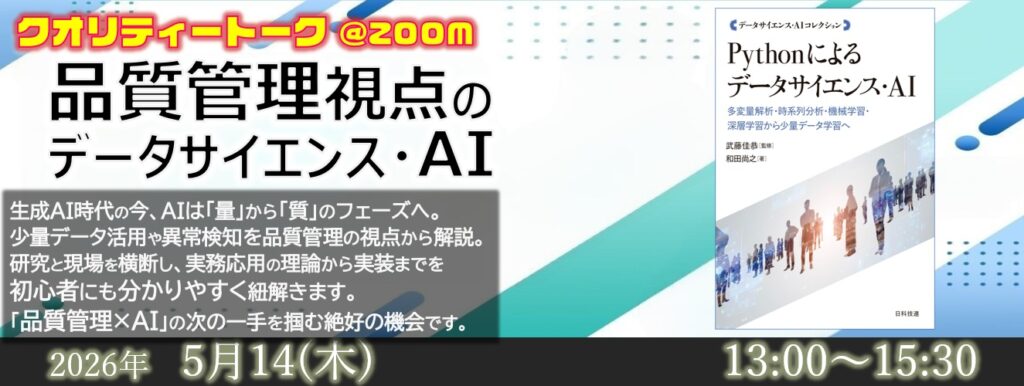

続く5月は「品質管理視点のデータサイエンス・AI」と題し、和田尚之氏に登壇いただきます。

データが少なくても大丈夫!専門家が教える「失敗しないAI」の作り方

「AIには大量のデータが必要でしょ?」「うちの現場には無理かな…」と思っていませんか?実は今、少量のデータから「賢い予兆」を見つけ出す技術が注目されています。 大切なのは、日本がずっと得意としてきた「品質管理」の考え方。 ベストセラー著者の和田先生が、難しい数式抜きで、AIをどう現場に活かすか分かりやすく解説します。AIの第一歩を、ここから始めてみませんか?

和田氏の書籍はこちらから↓

奮ってご参加ください

投稿者プロフィール

最新の投稿

お知らせ2024年5月24日3月開催の事業所見学会レポート

お知らせ2024年5月24日3月開催の事業所見学会レポート お知らせ2025年7月21日事業所見学会レポート スウェーデンハウス 2005年1月開催

お知らせ2025年7月21日事業所見学会レポート スウェーデンハウス 2005年1月開催 お知らせ2024年2月20日1月開催のシンポジウムレポート

お知らせ2024年2月20日1月開催のシンポジウムレポート お知らせ2024年7月19日5月開催の研究発表会レポート

お知らせ2024年7月19日5月開催の研究発表会レポート